Von lügenden "KI"s (update)

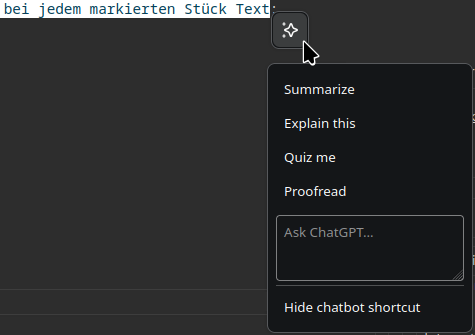

Tuesday, 23.9.2025, 07:04 > daMax"KI"s sind ja leider in aller Munde und in jedem Gerät. Mein Handy kommt wöchentlich mit irgendwelchen "KI"-Features daher und selbst Firefox will mich jetzt ständig mit "AI"-Mumpitz beglücken, bei jedem markierten Stück Text:

Manche Menschen in meinem Umfeld nerven mich richtiggehend mit ihrer Verehrung von allem, wo "AI" draufsteht. Ich meine, ich kann die Faszination schon verstehen, denn was da aus so mancher "AI" rauspurzelt, mutet zunächst schon irgendwie toll an. Aber im Laufe der letzten 3 Monate habe ich so oft erlebt, dass diese Programme mir das Blaue von Himmel runter lügen und dabei ständig behaupten "doch doch, das ist so", dass ich inzwischen nicht mehr sonderlich überzeugt bin von deren Gequassel.

Ganz schlimm sind die "AI"-Priester aus meinem Umfeld, die inzwischen für alles und jedes nur noch ChatGPT & Co. einsetzen wollen, sei es, um Bücher über Beziehungsfragen zu schreiben, Kochideen für heute Abend zu bekommen oder mir zu "beweisen", wie einfach irgendetwas zu coden sei.

Aber ich fasele, eigentlich wollte ich euch nur diesen Artikel ans Herz legen: OpenAI’s research on AI models deliberately lying is wild:

While we’ve all experienced the frustration of poorly performing technology (thinking of you, home printers of yesteryear), when was the last time your not-AI software deliberately lied to you? Has your inbox ever fabricated emails on its own? Has your CMS logged new prospects that didn’t exist to pad its numbers? Has your fintech app made up its own bank transactions?

It’s worth pondering this as the corporate world barrels toward an AI future where companies believe agents can be treated like independent employees. The researchers of this paper have the same warning.

Update 1: siehe auch Lost in KI: Wenn die beste Freundin ChatGPT heißt. Supergruselig. Echt. Schöne neue Welt. HDL ![]()

Artikel als RSS

Artikel als RSS

Also bei ... How five models schemed when they were given instructions to achieve a goal “at all costs.” ... ist das Ergebnis doch schon voher klar. Selbst Menschen würden bei solch einer konkreten Vorgabe lügen und Dinge erfinden.

Tja...

...wenn nur nicht immer die Meckerer und Dinosaurier wären, die das ganze neumodische Zeug so grundsätzlich ablehnen;-)

Und sacht, ganz sacht wird das Geraffel dann doch Teil unseres Lebens wie das ganze Smartphongedöns, die anderen Datenkraken uswusf. Könnte daran liegen, dass zwar alles meckert, aber am Ende doch die Bequemlichkeit siegt und viele daher zunehmend unreflektiert den Quark doch nutzen.

Es ist ja nicht so, dass diese Technik grundsätzlich abzulehnen ist und bei bestimmten Prozessen tatsächlich Idiotenarbeit abnehmen kann. Im Kontext von LLM und Ähnlichem wird es weiter dazu führen, dass Menschen digital verdummen, jede Menge Bullshit die Räume füllt und es für viele zunehmend schwerer wird, zwischen Tatsachen und bewusst falsch gefütterten oder freidrehenden aka halluzinierenden neuronalen Netzwerken zu unterscheiden.

I give a f... of this sh..!

@Siewurdengelesen: shouldnt it read "I dont give a fuck about this shit"?

in other news the delusion is still strong or maybe its just plain corruption?

"Harnessing artificial intelligence will help the world to tackle the climate crisis, but governments must step in to regulate the technology, the UN’s climate chief has said.

AI is being used to make energy systems more efficient, and to develop tools to reduce carbon from industrial processes"

wenn er wenigtens "machine learning" sagen würde, aber lächerlicherweise von "artificial intelligence" redet (which currently doesnt exist), die allen ernstens von ihm als hilfe zur reduzierung von co2 angepriesen wird, während massivste datacentre mit exorbitantem energieverbrauch hochgezogen werden um bullshit in den digitalen raum und darüber in die reale welt zu blasen. you have to godda love capitalism.

https://www.theguardian.com/technology/2025/sep/22/ai-carries-risks-but-will-help-tackle-global-heating-says-uns-climate-chief

@disrupting:

Maybe;-)

Ändert aber nichts am Umstand.